SLV Install - Kafka

SLV Install - Kafka

Зачем Kafka Cluster?

Apache Kafka обеспечивает надежный high-throughput event streaming для real-time data pipelines, распределенных сервисов и аналитики. Развертывание Kafka cluster через

slv install дает согласованную конфигурацию brokers, defaults для topics и observability hooks без необходимости поддерживать кастомные скрипты.Основные моменты

- Kafka: https://kafka.apache.org/

- Обрабатывает миллионы сообщений в секунду с надежными гарантиями сохранности.

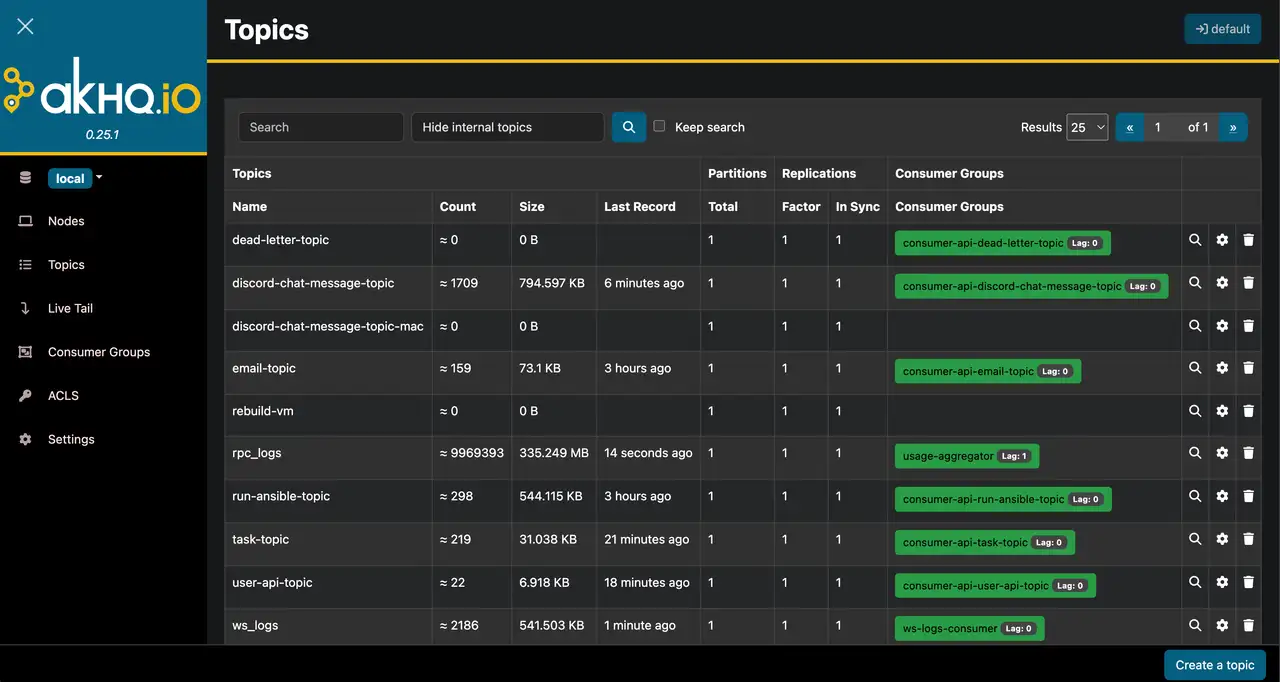

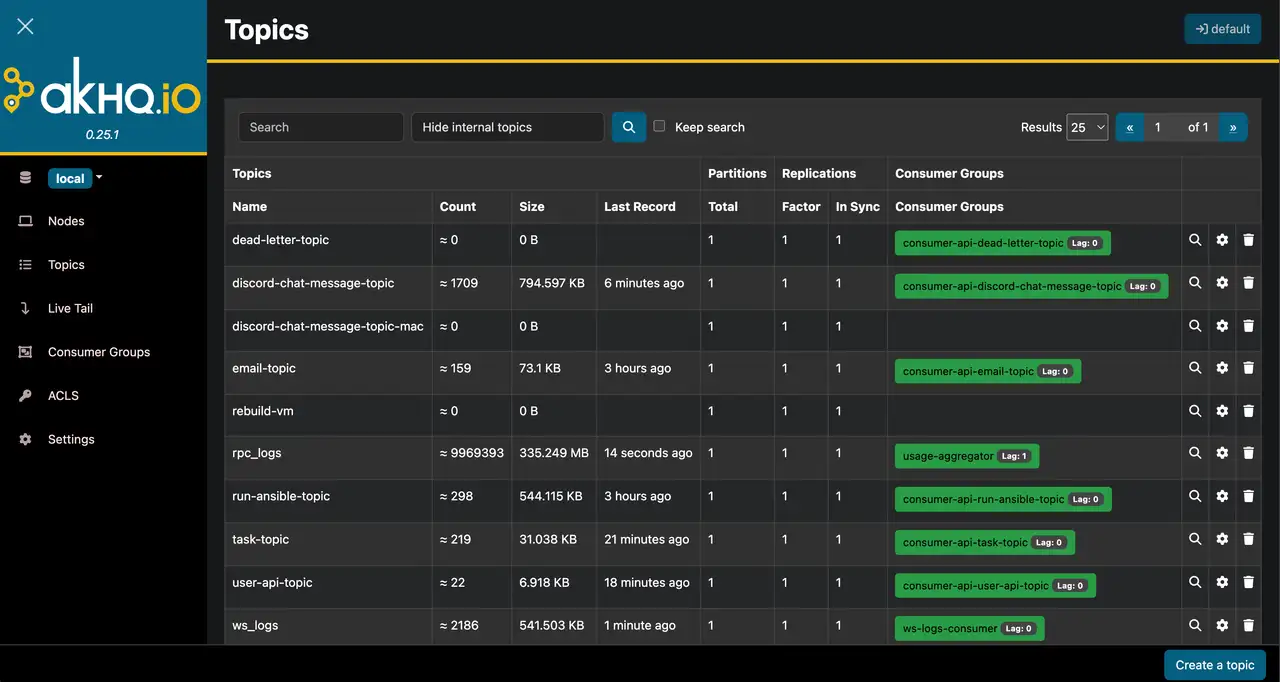

- Поставляется вместе с AKHQ UI для быстрого просмотра topics, мониторинга consumer lag и отладки.

Запустите installer

Направьте

slv install на hosts, на которых будут работать Kafka brokers, и выберите опцию Kafka Cluster.bash

$ slv install -i 1.1.1.1,

🚀 Installing software components...

? Select Software Component to Install (Redis)

Redis

TiDB (MySQL Cluster)

Grafana

Prometheus

Node Exporter

❯ Kafka Cluster$ slv install -i 1.1.1.1,

🚀 Installing software components...

? Select Software Component to Install (Redis)

Redis

TiDB (MySQL Cluster)

Grafana

Prometheus

Node Exporter

❯ Kafka ClusterПримечание: замените1.1.1.1на IP-адрес вашего сервера.

Проверьте детали

Перед продолжением перепроверьте inventory и путь к playbook. Если нужно ограничить выполнение только определенными hosts из inventory, передайте

--limit.bash

🚀 Installing software components...

? Select Software Component to Install (Redis) › Kafka Cluster

✅ You selected: Kafka Cluster

📋 Installation Details:

Software: Kafka Cluster

Inventory: 1.1.1.1,

Playbook: /Users/fumi/.slv/template/0.9.800/ansible/cmn/software/install-kafka.yml

? Do you want to proceed with the installation? (y/N) › 🚀 Installing software components...

? Select Software Component to Install (Redis) › Kafka Cluster

✅ You selected: Kafka Cluster

📋 Installation Details:

Software: Kafka Cluster

Inventory: 1.1.1.1,

Playbook: /Users/fumi/.slv/template/0.9.800/ansible/cmn/software/install-kafka.yml

? Do you want to proceed with the installation? (y/N) › Наблюдайте за выполнением Ansible

slv вызывает Ansible для настройки Kafka brokers, systemd services и вспомогательных компонентов, таких как ZooKeeper (если он требуется вашим template).bash

🚀 Running ansible: ansible-playbook -i 1.1.1.1, -u solv /Users/fumi/.slv/template/0.9.800/ansible/cmn/software/install-kafka.yml

PLAY [Install and configure Kafka Cluster] ***********************************************************

TASK [Gathering Facts] *******************************************************************************🚀 Running ansible: ansible-playbook -i 1.1.1.1, -u solv /Users/fumi/.slv/template/0.9.800/ansible/cmn/software/install-kafka.yml

PLAY [Install and configure Kafka Cluster] ***********************************************************

TASK [Gathering Facts] *******************************************************************************Проверьте endpoints

Когда playbook завершится, CLI выведет broker endpoint и адрес AKHQ UI, чтобы вы могли сразу начать публикацию и просмотр сообщений.

bash

✅ Installation completed successfully!

🌐 Access Information:

Kafka Broker Endpoint: 1.1.1.1:9092

AKHQ UI: http://1.1.1.1:5000✅ Installation completed successfully!

🌐 Access Information:

Kafka Broker Endpoint: 1.1.1.1:9092

AKHQ UI: http://1.1.1.1:5000Dashboard

Откройте AKHQ по адресу

http://1.1.1.1:5000, чтобы просматривать topics, изучать lag разделов и управлять consumer groups. Для полного observability stack streaming имеет смысл дополнить это dashboards в Grafana, например на основе метрик Kafka Exporter.